Prawie dekadę temu zrobiłem mały eksperyment. Napisałem prosty symulator, w którym „sprzedawałem” zasoby serwerowe kilku zespołom badawczym. Ustawiłem startowe ceny, włączyłem pętlę i patrzyłem, jak system sam się układa. Po godzinie miałem coś, co przypominało cudowne dopasowanie podaży do popytu. Po dwóch godzinach… wszystko się rozjechało, bo dwie grupy zaczęły „cwaniakować” przy zgłoszeniach. Wtedy zrozumiałem, że rynek działa jak komputer: liczy rozwiązanie, ale liczy w warunkach awarii, opóźnień i ludzkiej sprytności. I dokładnie to mnie w tym dziś interesuje.

Poniżej układam narzędzia, którymi da się badać rynek jak system obliczeniowy, i pokazuję, jak to przełożyć na działające protokoły z metrykami, a nie tylko akademickie deklaracje.

Rynek jako algorytm dualny

Jeśli ktoś lubi równania, wystarczy mu jedno zdanie: mnożniki Lagrange’a to ceny. Agenci maksymalizują własne „użyteczności minus rachunek”, a mechanizm cenowy koryguje stawki tak, by zniknęły nadwyżki popytu. Kiedy preferencje są „gładkie” i nie ma brutalnych komplementarności, cały układ zachowuje się jak subgradient na problemie dualnym. Stare francuskie tâtonnement to po prostu kolejna iteracja: nowa cena równa się poprzednia plus krok w stronę nadwyżki popytu, przycięty do zera tam, gdzie dobra jest w bród.

Brzmi sucho, ale ma prosty morał. Dobre klasy preferencji dają się policzyć w rozproszony sposób. Każdy agent rozwiązuje swój mały problem u siebie, a „sieć” dba tylko o ceny. I właśnie dlatego ceny są tak sprytne: są skompresowaną informacją o reszcie świata.

Koszt informacji, czyli ile gadania potrzeba do porządnej alokacji

Świat idealny wymagałby, żeby każdy mówił wszystkim wszystko o swoich preferencjach. Świat realny ma budżet bitów. Zamiast całych funkcji użyteczności wysyłamy tylko popyt przy danej cenie. To oszczędza komunikację, ale ma cenę: szybkie, małomówne protokoły zwykle dają przybliżenia albo stabilność w sensie „małego żalu”, nie perfekcyjne optimum.

Warto nazywać rzeczy po imieniu. Tu jest prawdziwy kompromis: dokładność kontra rozmowność. Jeśli system ma reagować w minutach, a nie w dniach, trzeba pogodzić się z tym, że dostajemy rozwiązania dobre do życia, a nie „idealne w teorii”.

Odporność i złośliwość w wersji rynkowej

Jedna rzecz to rachunek. Druga to realia sieci. W praktyce mamy asynchroniczne aktualizacje, brak wspólnego zegara, skoki opóźnień i całą paletę zachowań strategicznych. W języku inżyniera: część węzłów bywa byzanceńska. Ktoś zgłasza popyt większy niż potrzebuje, żeby przesunąć stawkę. Albo spamuje żądaniami i „rozgrzewa” mechanizm aktualizacji.

Da się z tym żyć, pod warunkiem że w sam protokół wpiszemy bezpieczniki: ograniczenie tempa zmian zgłoszeń, obniżanie wagi skrajnych sygnałów przy agregacji, a w cięższych przypadkach kaucję przepadającą przy wykrytym spoofingu. I jeszcze jedno. Klasyczny wynik z teorii mechanizmów mówi, że nie dostaniemy na raz pełnej efektywności, twardej zgodności budżetowej i szczelnej odporności na cwaniactwo. Trzeba wybrać dwa. To nie jest kaprys, to jest strukturalne ograniczenie.

Algorytmy, które już są rynkami

Nie trzeba wymyślać od zera. Mamy gotowe klocki.

Po pierwsze, aukcje Kelso–Crawford dla klas substytutów. Proste reguły podnoszenia stawek, przewidywalna zbieżność, mało komunikacji. Idealne do wyceny zasobów „sztukowych”.

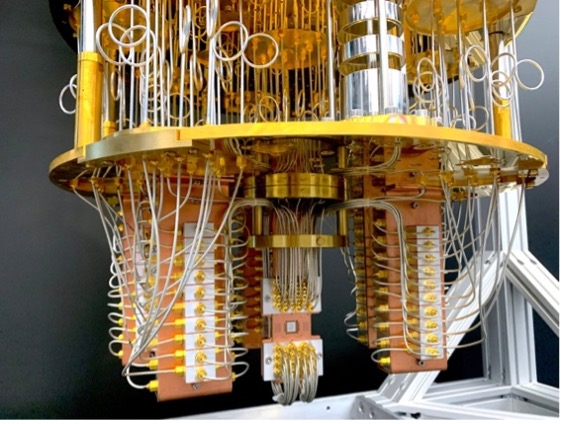

Po drugie, metody primal–dual w stylu ADMM, które świetnie działają na grafach. Każda krawędź dostaje własny „cennik”, węzły rozwiązują lokalne zadania, a wiadomości krążą tylko między sąsiadami. Energia, transport, chmura obliczeniowa, handel pasmem w sieci – to są naturalne miejsca na taki układ.

Po trzecie, dynamiki no-regret, czyli uczenie się na własnych błędach. W reklamie, HFT i każdej grze powtarzanej to bywa bardziej sensowne niż polowanie na jedną równowagę. Mały żal u każdego gracza wystarcza, by całość działała dobrze.

Gdzie to pęka i jak łatać

Pęka przy komplementarnościach i niepodzielnościach. Przetargi pakietowe to twardy orzech. Tu sprawdza się ograniczenie palety pakietów, aukcje hierarchiczne i podparcie się MILP-em tam, gdzie instancja jest mała.

Pęka przy dobrach publicznych i zewnętrznych kosztach. Ceny prywatne nie „widzą” smogu. Tu potrzeba instrumentów okołorynkowych: podatków w stylu Pigou, kredytów, uprawnień. Prosta prawda: sam mechanizm cenowy bez fiskusa nie domknie całości.

Pęka w ruchomych piaskach. Preferencje i zasoby potrafią zmieniać się szybciej niż zbiega algorytm. Wtedy przestawiamy się na myślenie online. Liczy się nie „teoretyczna równowaga”, tylko żal dynamiczny w oknie czasu.

Mini laboratorium, które możesz uruchomić jutro

Jeśli chcesz z tym pobrudzić ręce, zrób małe laboratorium.

Krok 1. Symulator rynku Fishera z preferencjami liniowymi i CES. To kilka klas w Pythonie.

Krok 2. Trzy protokoły: subgradient cenowy w wersji tâtonnement, entropijny mirror descent ze stabilizatorem na ruch cen, oraz ADMM, który rozcina problem po zasobach.

Krok 3. Dołóż realia sieci: losowe opóźnienia, gubienie pakietów, częściową obserwowalność.

Krok 4. Wstrzyknij 10 procent „złych aktorów”: zawyżone popyty, spoofing, niestabilne zgłoszenia. Na agregacji użyj mediany albo median-of-means.

Krok 5. Mierz to, co ważne: lukę dobrobytu względem optimum, czas do osiągnięcia małych nadwyżek popytu, liczbę bitów w komunikacji, stabilność trajektorii cen, spadek wydajności przy rosnącej latencji. To jest raport, który da się czytać, bo pokazuje krzywe zbieżności zamiast deklaracji.

Krótka historia z praktyki

Wspólnota energetyczna na osiedlu. Kilkadziesiąt domów z fotowoltaiką, magazyn energii na rogu i chęć, by mniej płacić operatorowi. Zamiast „uczyć” ludzi nowego języka, wprowadziliśmy proste zgłoszenia popytu przy cenie z ostatniej godziny, ograniczyliśmy tempo zmian ofert i opublikowaliśmy jedynie potrzebne statystyki: nadwyżkę energii, stawkę na najbliższą godzinę i informację o obciążeniu magazynu. Po miesiącu wykresy były nudne, czyli stabilne. Po dwóch miesiącach część sąsiadów próbowała „przewidywać” stawki i grać pod system. Kaucja na uczestnictwo i obniżanie wagi skrajnych zgłoszeń załatwiły sprawę. Nie twierdzę, że to złoty standard. To tylko znak, że myślenie algorytmiczne działa także poza salą wykładową.

Co mierzyć i jak nie oszukiwać samego siebie

Trzy miary trzymam zawsze na wierzchu.

Po pierwsze, luka dobrobytu w czasie. Nie w jednej chwili, tylko jako krzywa. Po drugie, łączny żal graczy lub operatora ceny. Jeśli spada, system się uczy. Po trzecie, koszt rozmowy. Ile wiadomości trzeba, żeby zejść poniżej progu nadwyżek popytu. Do tego dorzucam wrażliwość na opóźnienia i odsetek węzłów, które mogą kłamać, zanim wszystko się posypie.

Jest jeszcze sprawa polityczna. Kto pisze protokół, ten zgarnia rentę. Nie ma niewinnych mechanizmów. Dobór reguł ustala, kto ma przewagę. Warto to mówić głośno, zwłaszcza gdy mechanizm trafia do infrastruktury.

Na koniec

Rynek nie jest magiczną ręką, tylko warsztatem do liczenia alokacji. Gdy zaczniemy traktować ceny jak sygnały w rozproszonym algorytmie, nagle widać, co poprawić: krok aktualizacji, tempo rozmowy, filtry na złośliwość. I równie jasno widać granice. Komplementy bolą. Dobra publiczne bez polityki nie zagrają. Ale to dobrze. Przynajmniej wiemy, gdzie kończy się bajka, a zaczyna robota.