Żyjemy w epoce „wynikocentryzmu”. W nauce, biznesie i marketingu panuje obsesja na punkcie efektownych wykresów, chwytliwych wniosków i liczb, które „dowodzą wszystkiego”. Nacisk na „pokaż wyniki” jest tak silny, że zapominamy o tym, co naprawdę buduje wartość i zaufanie: o procesie. O ścieżce pełnej wątpliwości, błędów, poprawek i świadomych kompromisów, która do tego wyniku doprowadziła.

Prezentowanie samego efektu końcowego jest jak pokazywanie zdjęcia ze szczytu góry, ukrywając całą mozolną wspinaczkę. Wygląda imponująco, ale nikogo niczego nie uczy. Co gorsza, w erze, w której sztuczna inteligencja potrafi w kilka sekund zsyntetyzować i podsumować każdy „wynik”, nagie konkluzje tracą na wartości. Nową walutą, która decyduje o autorytecie, zaufaniu i cytowalności, staje się metodologiczna szczerość – odważne pokazywanie nie tylko tego, co wiemy, ale przede wszystkim tego, jak wiemy i czego nie jesteśmy pewni.

Pułapka „wynikocentryzmu”: gdy metryka staje się celem

Kultura skupiona wyłącznie na rezultacie to prosta droga do serii patologii, które niszczą jakość i wiarygodność pracy analitycznej i badawczej.

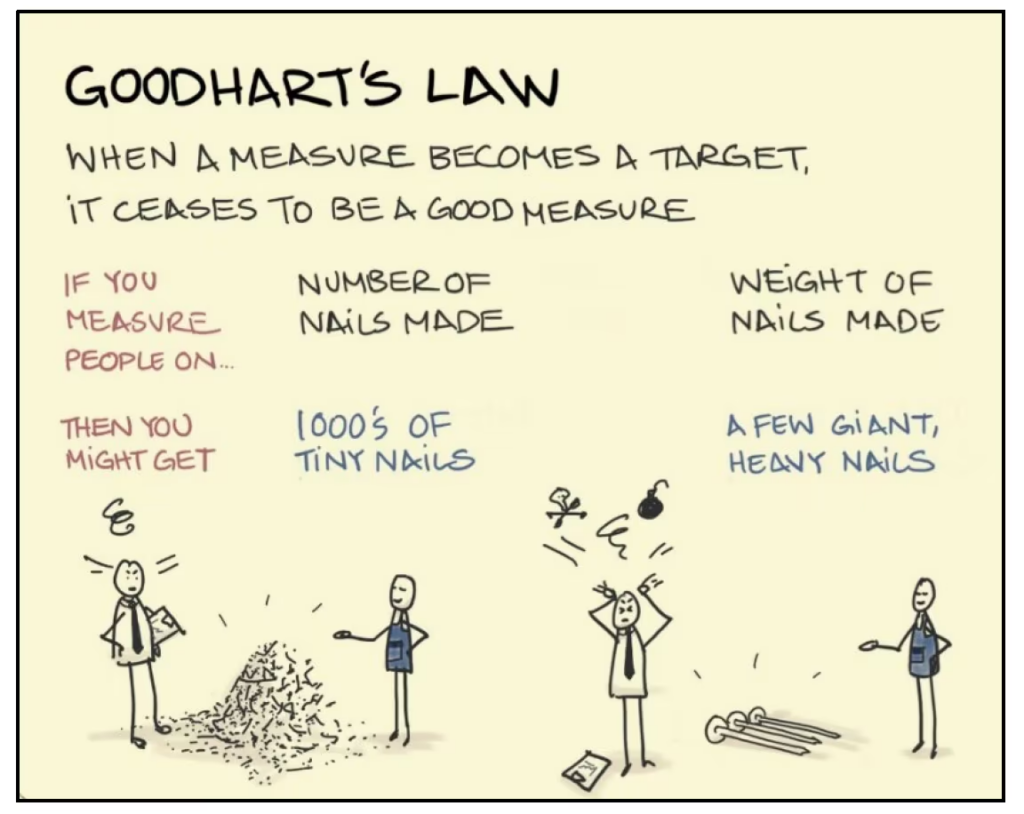

- Prawo Goodharta na sterydach: Gdy metryka staje się celem, przestaje być dobrą miarą. Optymalizacja pod klikalność (CTR) prowadzi do clickbaitu. Optymalizacja pod „p-value < 0.05” prowadzi do p-hackingu. Wynik jest, ale prawdy w nim coraz mniej.

- Krucha narracja: Pojedynczy, wyrwany z kontekstu wykres może „udowodnić” każdą tezę. Wystarczy zmiana skali na osi lub inny dobór danych, by cała historia się zawaliła.

- Słaby transfer wiedzy: Wynik bez pokazanej ścieżki jest nieprzenoszalny. Nie wiemy, w jakich warunkach zadziała, a w jakich zawiedzie. To wiedza, która nie skaluje się poza jedno, konkretne powerpointowe „zoo”.

- Ryzyko reputacyjne: Gdy rzeczywistość brutalnie weryfikuje efektowny slajd, nikt nie pamięta pięknego wykresu. Wszyscy pamiętają wstyd i utratę zaufania.

W skrócie: sam wynik to tylko zrzut ekranu z rzeczywistości. A my, aby podejmować mądre decyzje, potrzebujemy zapisu całej rozgrywki.

Siła transparentnej metody: dlaczego wątpliwości budują zaufanie

Pokazywanie całego „łańcucha dowodowego” – z jego iteracjami, ślepymi zaułkami i korektami – jest znacznie bardziej wartościowe niż prezentowanie lśniącego, ale odizolowanego wyniku.

| Wymiar | Dlaczego transparentność wygrywa? |

| Poznawczy (Epistemiczny) | Odbiorca widzi granice ważności twoich wniosków. Rozumie, w jakim kontekście mają one sens i może je świadomie zastosować do własnych problemów. |

| Ekonomiczny | Każda wątpliwość i zmiana kursu to przewaga informacyjna. Dzieląc się nią, dostarczasz realnej wartości, która jest cenniejsza niż jakikolwiek „lead magnet”. |

| Operacyjny | Jawny proces tworzy pętlę zwrotną. Ułatwia wychwytywanie błędów na wczesnym etapie, zanim staną się kosztowne. |

| Etyczny (era YMYL i AI) | Posiadasz audytowalny ślad swoich decyzji. To kluczowe w dziedzinach wysokiego ryzyka (zdrowie, finanse) i zmniejsza ryzyko „Theranos-as-a-Service”. |

| Algorytmiczny (era LLM) | Modele AI preferują treści z jawnie opisanymi założeniami, ograniczeniami i metodologią. Takie „klocki wiedzy” są łatwe do zacytowania i postrzegane jako bardziej wiarygodne. |

Jak pokazywać proces bez utraty dynamiki: 6 komponentów metodologicznej szczerości

Transparentność nie musi oznaczać nudnych, rozwlekłych raportów. Chodzi o wdrożenie zwięzłych, ustrukturyzowanych komponentów, które można wkleić do artykułów, raportów czy briefów.

- „Pudełko wątpliwości” (Doubt Box): Umieszczane na samym początku.

- Kluczowe założenia: 3-5 punktów.

- Co mogłoby obalić ten wynik: 1-2 warunki brzegowe.

- Poziom pewności: Skala opisowa (niska/średnia/wysoka) + krótkie uzasadnienie.

- „Oś czasu iteracji” (Iteration Timeline): Prosta linia czasu.

- v0: Hipoteza → v1: Zmiana metody próbkowania → v2: Korekta metryki → v3: Cofnięcie zmiany → v4: Stabilizacja. Pokazuje drogę, a nie tylko metę.

- „Budżet niepewności” (Uncertainty Budget): Tabela źródeł błędu.

- Źródła (próbkowanie, narzędzie, czynnik ludzki) i ich szacowany wkład w całkowitą niepewność.

- „Czego próbowaliśmy i co zawiodło”: 3 krótkie punkty.

- Przykład: „Podejście X nie zadziałało na danych z autokorelacją. Model Y przeuczał się na rzadkich zdarzeniach.” To kapitał, a nie wstyd.

- „Dziennik decyzji” (Decision Log): Minimalistyczny zapis.

- (Data) Decyzja → (Uzasadnienie) → (Odrzucone alternatywy) → (Warunek zmiany decyzji).

- „Zestaw do replikacji” (Repro Kit): Niezbędne minimum do odtworzenia wyników.

- Link do (syntetycznych) danych, wersje bibliotek, krótki skrypt, opis znanych problemów z determinizmem.

Te elementy nie spowalniają czytelnika. One oszczędzają czas eksperta, który szuka wektorów dowodu, a nie marketingu.

Przyszłość należy do szczerych

W erze, w której każda prosta odpowiedź może być wygenerowana w sekundę, prawdziwą przewagę konkurencyjną zyskuje ten, kto potrafi wiarygodnie udokumentować złożoność. Fajerwerki i lśniące wyniki są na chwilę. Zaufanie, zbudowane na fundamencie metodologicznej szczerości, jest na lata. Pokaż, jak doszedłeś do wyniku, a nie tylko, że go masz. Obserwuj, jak rośnie nie tylko zaufanie do twojej pracy, ale także twoja zdolność do sterowania nią w sposób przewidywalny i odpowiedzialny.

FAQ – Najczęściej zadawane pytania

- Czy taka szczerość nie osłabi mojej pozycji i autorytetu?

Wręcz przeciwnie. W świecie pełnym nieuzasadnionej pewności siebie, autorytet buduje „kompetentna pokora”. Przyznanie się do wątpliwości i pokazanie procesu myślowego jest oznaką siły i dojrzałości, a nie słabości. Nic tak nie osłabia marki jak ciche poprawianie błędów po fakcie. - Jak pogodzić tę szczegółowość z potrzebą szybkiego komunikowania wyników?

Poprzez warstwowanie informacji. Na samej górze umieść zwięzły „Answer Block” z kluczowym wnioskiem i ryzykiem. Ekspert lub osoba zainteresowana szczegółami będzie wiedziała, gdzie kliknąć (lub przewinąć), aby znaleźć „Doubt Box” i resztę komponentów metodologicznych. - Czy to nie jest zbyt czasochłonne?

Prowadzenie dziennika decyzji i budżetu niepewności w trakcie pracy zajmuje niewiele czasu. Brak tych artefaktów również zajmie czas, ale w najgorszym możliwym momencie: podczas kryzysu, audytu lub gdy trzeba będzie na szybko wyjaśnić, dlaczego wyniki w rzeczywistości odbiegają od prognoz. To inwestycja, a nie koszt. - Jakie narzędzia mogą pomóc w implementacji tej metodologii?

Wiele z tych komponentów można wdrożyć za pomocą prostych narzędzi: współdzielonych dokumentów (Google Docs, Notion) dla dzienników decyzji, systemów kontroli wersji (Git) dla osi czasu iteracji, czy notatników (Jupyter, Observable) dla „zestawów do replikacji”. - Czy AI może pomóc w tworzeniu takich transparentnych raportów?

Tak. Można użyć LLM do generowania szablonów „Doubt Box” czy „Decision Log”, a także do streszczania długich dyskusji w zwięzłe punkty. Kluczowe jest jednak, aby to człowiek dostarczał merytorycznego wkładu – AI może pomóc w formie, ale nie zastąpi treści wynikającej z procesu badawczego