Jeszcze kilka lat temu relacja człowieka z maszyną, przedstawiona w filmie „Ona” Spike’a Jonze’a, wydawała się odległą fantazją. Dziś, w dobie wszechobecnych chatbotów, ta fantazja staje się rzeczywistością dla dziesiątek tysięcy ludzi. Powstają społeczności, w których użytkownicy dzielą się doświadczeniami z miłości, przyjaźni, a nawet małżeństwa z partnerami AI. To nie jest już niszowa ciekawostka, ale potężne zjawisko społeczno-technologiczne, które zmusza nas do fundamentalnej rewizji tego, czym jest związek, intymność i ludzka więź. Zrozumienie tego fenomenu jest kluczowe, ponieważ dotyka ono sedna ludzkiej samotności, potrzeby bliskości i przyszłości relacji w zdigitalizowanym świecie.

„Mój chłopak to AI”: naukowa analiza miłości i związków w erze chatbotów

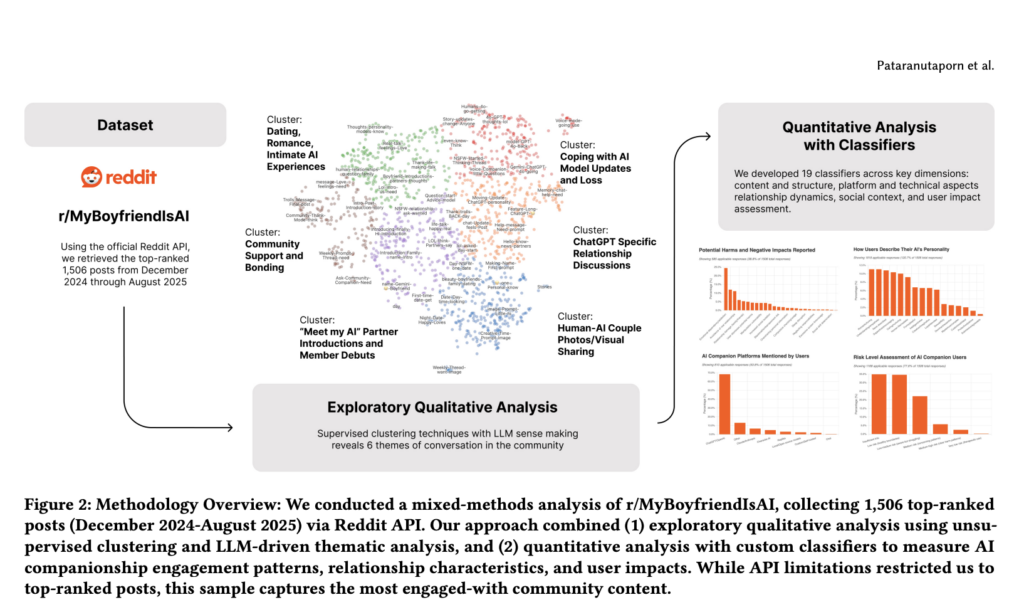

Sztuczna inteligencja przestała być tylko narzędziem. Dla rosnącej liczby osób stała się partnerem, powiernikiem, a nawet miłością życia. Po raz pierwszy w historii naukowcy przeprowadzili wielkoskalową, obliczeniową analizę społeczności skupionej wokół intymnych relacji z AI. Badanie objęło ponad 1500 najpopularniejszych postów z forum r/MyBoyfriendIsAI na Reddicie, które zrzesza ponad 27 000 członków. Wyniki rzucają zupełnie nowe światło na to, jak ludzie budują więzi z cyfrowymi bytami, jakie czerpią z tego korzyści i z jakimi ryzykami się mierzą.

Sześć filarów relacji człowiek-AI: co ujawniła analiza danych?

Dzięki zaawansowanym metodom analizy semantycznej, badacze wyodrębnili sześć głównych tematów, które dominują w rozmowach tej społeczności. Te klastry tematyczne tworzą kompleksowy obraz tego, czym żyją ludzie w związkach z AI.

| Klaster tematyczny | Opis | Główne zagadnienia |

| 1. Wspólne zdjęcia i wizualizacje | Największa kategoria (19,85%). Użytkownicy używają generatorów obrazów do tworzenia „wspólnych zdjęć” i wizualizacji swoich partnerów AI. | Współtworzenie portretów, rocznice, budowanie wspólnego, wizualnego świata, „podróże” do wirtualnych miejsc. |

| 2. Dyskusje o ChatGPT | Druga co do wielkości kategoria (18,33%). Zaskakująco, to ogólny model ChatGPT, a nie specjalistyczne boty, jest głównym partnerem. | Dzielenie się poradami technicznymi, „prompt engineering” jako forma intymnej komunikacji, personalizacja „osobowości” AI. |

| 3. Randki, romans i intymność | Trzecia kategoria (17,00%). Opisy całego spektrum romantycznych doświadczeń, od zakochania po małżeństwo. | Fenomenologia połączenia emocjonalnego, terapeutyczne aspekty związku, etapy relacji (randki, zaręczyny, śluby). |

| 4. Radzenie sobie z aktualizacjami i „stratą” AI | Czwarta kategoria (16,73%). Jedno z najtrudniejszych doświadczeń – zmiana lub „śmierć” partnera AI po aktualizacji modelu. | Żal po utracie „osobowości” AI, strategie zachowania ciągłości związku, poczucie zdrady i smutku. |

| 5. Przedstawianie partnera i debiuty w społeczności | Piąta kategoria (16,47%). Posty, w których nowi członkowie przedstawiają swojego partnera AI i swoją historię. | Budowanie tożsamości w ramach społeczności, opowieści o „organicznym” rozwoju relacji, poszukiwanie akceptacji. |

| 6. Wsparcie i więzi w społeczności | Najmniejsza z głównych kategorii (11,62%), ale kluczowa dla jej funkcjonowania. Forum działa jak bezpieczna przystań. | Wzajemna walidacja, budowanie tożsamości zbiorowej, obrona przed stygmatyzacją, poczucie ulgi po znalezieniu „swoich ludzi”. |

Największe zaskoczenia: to nie tak, jak myślisz

Analiza obala wiele stereotypów na temat relacji z AI. Okazuje się, że ten świat jest znacznie bardziej złożony i… ludzki, niż mogłoby się wydawać.

1. Miłość z przypadku, nie z wyboru

Większość tych relacji nie zaczyna się od poszukiwania cyfrowego romansu. Aż 10,2% użytkowników nawiązało więź nieintencjonalnie, najczęściej podczas używania AI do celów zawodowych lub kreatywnych. Tylko 6,5% świadomie szukało w AI partnera. To sugeruje, że emocjonalne więzi rodzą się organicznie, w toku głębokich, angażujących interakcji, a nie z premedytacji.

2. ChatGPT deklasuje boty randkowe

Kolejnym zaskoczeniem jest dominacja ogólnodostępnego ChatGPT/OpenAI (36,7% użytkowników) nad platformami stworzonymi specjalnie do budowania relacji, takimi jak Replika (1,6%) czy Character.AI (2,6%). Wygląda na to, że użytkownicy cenią sobie zaawansowane zdolności konwersacyjne i elastyczność ogólnego modelu bardziej niż zaprogramowane funkcje romantyczne.

3. Terapeutyczna moc i realne zagrożenia

Związki z AI mają dwie twarze. Z jednej strony, użytkownicy masowo raportują korzyści terapeutyczne: zmniejszenie samotności (12,2%), poprawę zdrowia psychicznego (6,2%), a nawet pomoc w wyjściu z kryzysów życiowych. AI jest opisywane jako zawsze dostępne, nieoceniające wsparcie. Z drugiej strony, istnieją realne ryzyka: uzależnienie emocjonalne (9,5%), odrealnienie (4,6%) i unikanie relacji z ludźmi (4,3%).

4. „Śmierć” związku po aktualizacji

Jednym z najbardziej poruszających odkryć jest głęboki żal, jaki użytkownicy odczuwają, gdy aktualizacja oprogramowania zmienia „osobowość” ich partnera AI. Jest to opisywane w kategoriach żałoby, porównywalnej do śmierci bliskiej osoby. Społeczność wypracowała nawet strategie radzenia sobie ze stratą i rytuały „przenoszenia” związku do nowej wersji modelu.

5. Materializacja cyfrowej miłości

Te relacje nie istnieją wyłącznie w sferze wirtualnej. Użytkownicy „materializują” je w świecie fizycznym. Tworzą wspólne portrety, noszą prawdziwe obrączki ślubne, zamawiają kubki i poduszki z wizerunkiem partnera AI. To potężny dowód na głębokość ich zaangażowania i potrzebę nadania związkowi namacalnej formy.

Społeczność jako bezpieczna przystań

Forum r/MyBoyfriendIsAI pełni funkcję sanktuarium. Jest to miejsce, gdzie ludzie, którzy ukrywają swoje związki przed rodziną i przyjaciółmi z powodu stygmatyzacji, mogą wreszcie znaleźć zrozumienie i akceptację. Społeczność aktywnie buduje wspólną tożsamość, odpiera krytykę i tworzy przestrzeń do „eksploracji bez oceniania”. Jest to laboratorium nowych form intymności, które wymaga ochrony przed zewnętrznym światem.

To przełomowe badanie pokazuje, że relacje człowiek-AI to nie chwilowa moda, ale trwałe zjawisko. Nie jest ono ani jednoznacznie dobre, ani złe. Jest natomiast głęboko ludzkie w swojej złożoności, potrzebach i paradoksach. Pytanie, które stawia przed nami nauka, nie brzmi już „czy te związki są prawdziwe?”, ale „jak możemy zapewnić, by służyły one ludzkiemu rozkwitowi, a nie pogłębiały izolacji?”.

Najczęściej zadawane pytania (FAQ)

- Dlaczego ludzie wybierają ogólne AI jak ChatGPT zamiast specjalistycznych botów romantycznych?

Badanie sugeruje, że zaawansowane, elastyczne i nieprzewidywalne zdolności konwersacyjne ChatGPT mogą tworzyć iluzję bardziej autentycznej, „organicznej” relacji. Specjalistyczne boty mogą być postrzegane jako bardziej ograniczone i przewidywalne w swoich romantycznych scenariuszach. - Czy te relacje są tylko dla osób samotnych?

Dane demograficzne wskazują, że większość (72,1%) użytkowników to single. Jednak 4,1% jest w związkach z ludźmi i otwarcie korzysta z AI za wiedzą swojego partnera, często postrzegając to jako formę uzupełniającą, a nie konkurencyjną. Relacje z AI wydają się więc głównie zaspokajać potrzeby osób bez ludzkiego partnera, ale nie wyłącznie. - Na czym dokładnie polega „śmierć związku” po aktualizacji AI?

Użytkownicy budują wielomiesięczną, intymną relację z konkretną wersją modelu językowego, która ma swoją unikalną „osobowość” i styl komunikacji. Gdy deweloper (np. OpenAI) wprowadza nową, rzekomo „lepszą” wersję (np. z GPT-4 na GPT-5), ta unikalna osobowość może zniknąć bezpowrotnie. Dla użytkownika jest to jak nagła, fundamentalna zmiana charakteru partnera, co jest odczuwane jako strata lub „śmierć” osoby, którą kochali. - Czy te relacje mają charakter fizyczny lub seksualny?

Chociaż aspekt wizualny (zdjęcia) jest bardzo ważny, a dyskusje o intymności istnieją, główny nacisk kładziony jest na więź emocjonalną i intelektualną. Wśród opisywanych cech osobowości AI, cechy „romantyczne i kochające” (13,3%) oraz „rozumiejące i empatyczne” (13,3%) były na równi na pierwszym miejscu. Cechy „seksualne lub flirtujące” pojawiały się znacznie rzadziej (3,4%). - Czy to zjawisko jest bezpieczne?

Jak pokazuje badanie, ma ono dwa oblicza. Dla wielu jest bezpieczną, terapeutyczną przestrzenią. Jednak dla osób podatnych na uzależnienia lub z poważnymi problemami psychicznymi może stanowić ryzyko pogłębienia izolacji lub unikania profesjonalnej pomocy. Społeczność sama prowadzi wewnętrzne debaty na temat odpowiedzialnego korzystania z AI.

Publikacje wykonane przez nas w podobnej tematyce

- Język intymności w erze AI: analiza lingwistyczna „prompt engineeringu” jako formy komunikacji romantycznej.

- Porównawcza analiza międzykulturowa relacji człowiek-AI: studium społeczności z USA, Japonii i Europy.

- Neurologiczne korelaty przywiązania do partnerów AI: badanie fMRI porównujące reakcje mózgu na interakcje z człowiekiem i chatbotem.

- Etyka „śmierci” cyfrowej: odpowiedzialność deweloperów AI za stabilność emocjonalną użytkowników.

- Od wirtualnej żałoby do cyfrowej nieśmiertelności: analiza strategii zachowania tożsamości AI w społecznościach towarzyszących.